AI buộc các tổ chức phải mở rộng phạm vi kiểm toán, tăng cường kiểm soát rủi ro

Kiểm toán quốc tế - Ngày đăng : 14:02, 18/07/2024

Hàng loạt rủi ro liên quan đến AI

Theo nghiên cứu “Điểm nóng của kế hoạch kiểm toán 2024” do Gartner thực hiện, các giám đốc điều hành kiểm toán (CAE) xác định có 3 chủ đề chính tương ứng với 12 rủi ro buộc các tổ chức, doanh nghiệp và kiểm toán phải đặc biệt lưu ý trong năm 2024.

Theo đó, 3 chủ đề là: Áp lực về chi phí và tăng trưởng; áp lực đa chiều, nhiều mối đe dọa nội bộ và bên ngoài khiến các tổ chức trở nên dễ tổn thương; trách nhiệm giải trình được nâng cao. Tương ứng với các chủ đề trên là 12 rủi ro: An ninh mạng; quản trị công nghệ; sự phức tạp của các ứng dụng công nghệ; chuyển đổi; khả năng phục hồi; các bên thứ ba; chuỗi cung ứng; người lao động và văn hóa nơi làm việc; quản trị ESG; căng thẳng địa chính trị; GenAI (trí tuệ nhân tạo tạo sinh - một loại trí tuệ nhân tạo có thể tạo ra nhiều định dạng dữ liệu); kinh tế vĩ mô.

Một điểm đặc biệt được các chuyên gia của Gartner chỉ ra là có tới 6/12 rủi ro liên quan đến công nghệ, AI và GenAI. Cho dù các tổ chức xây dựng các ứng dụng GenAI nội bộ hay truy cập các công cụ công khai như: ChatGPT, Google Bard, việc giám sát và quản lý sử dụng đều là một thách thức. Kết quả khảo sát của Gartner cho thấy, có tới 46% nhân viên sử dụng ChatGPT như một phần trong ngày làm việc của họ, nhưng 68% trong số này không báo cáo với lãnh đạo của họ.

Thực tế, sự cố nhân viên nhập thông tin bí mật, nhạy cảm hoặc độc quyền vào ứng dụng GenAI đã được báo cáo, nhưng các tổ chức không biết thông tin đó được xử lý như thế nào hoặc liệu thông tin đó có được sử dụng để tạo ra một mô hình/dữ liệu khác hay không. Ngoài ra, nhiều ứng dụng vẫn yêu cầu quyền truy cập vào các dịch vụ của bên thứ ba, mở ra nhiều rủi ro tiềm ẩn về quyền riêng tư và bảo vệ dữ liệu.

Mặc dù việc thiết lập các chính sách trong toàn tổ chức và giáo dục nhân viên về cách sử dụng hợp lý các công cụ đã được triển khai, nhưng hầu hết các tổ chức đều gặp khó khăn trong việc theo kịp công nghệ. Cuộc thăm dò ý kiến các nhà lãnh đạo công nghệ thông tin về GenAI của Gartner (2023) cho biết, 36% tổ chức vẫn chưa có hướng dẫn nào về GenAI, trong khi 31% đang tạm dừng sử dụng GenAI và điều tra về nó.

Mức độ không chính xác của thông tin đầu ra là một trong những rủi ro được nêu ra nhiều nhất của các ứng dụng GenAI, đặc biệt là việc bịa đặt các trích dẫn pháp lý. Có 43% nhân viên sử dụng GenAI cho biết họ tin tưởng ChatGPT sẽ cung cấp kết quả chính xác, điều này càng làm dấy lên mối lo ngại khi các tổ chức sử dụng GenAI trong các lĩnh vực như: Phân tích và dự đoán dữ liệu, tiếp thị, quảng cáo và dịch vụ khách hàng. Điều này cho thấy, các tổ chức buộc phải tăng phạm vi của kiểm toán nội bộ và kiểm soát tốt hơn các mô hình AI.

Khi các tổ chức tăng cường sử dụng công nghệ AI mới, các kiểm toán viên nội bộ phải mở rộng phạm vi hoạt động. Thực tế, có quá nhiều rủi ro liên quan đến AI mà các tổ chức phải đối mặt và một nửa số rủi ro hàng đầu đã cho thấy kiểm toán nội bộ không thể bỏ qua AI.

Ông Thomas Teravainen - Chuyên gia nghiên cứu của Gartner

Giám sát, cảnh báo rủi ro và đánh giá các quy trình sử dụng AI

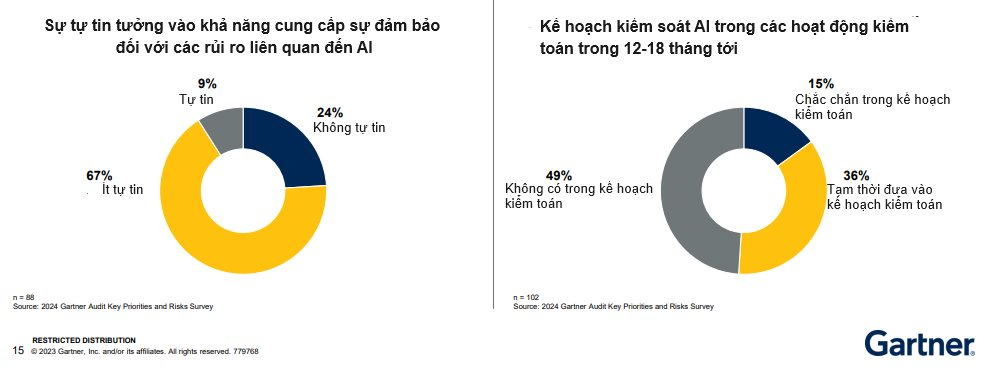

Mặc dù AI và các ứng dụng GenAI tạo ra nhiều rủi ro mới đối với an ninh mạng, bảo mật dữ liệu, quyền riêng tư, vi phạm bản quyền, cũng như mức độ tin cậy của đầu ra, nhưng có tới 62% giám đốc tài chính và 58% giám đốc điều hành tin rằng AI sẽ có tác động đáng kể nhất đến ngành của họ trong ba năm tới. Vấn đề nghiêm trọng hơn ở đây là các tổ chức và kiểm toán viên nội bộ thiếu tự tin vào khả năng giám sát hiệu quả các rủi ro AI. Chưa đến 11% CAE cho biết họ tự tin trong việc cung cấp sự đảm bảo về rủi ro liên quan đến AI.

Các chuyên gia của Gartner khuyến nghị, các kiểm toán viên nội bộ cần xem xét lại các hoạt động giám sát GenAI thông qua việc đánh giá cách sử dụng GenAI của nhân viên, khả năng rò rỉ dữ liệu, sở hữu trí tuệ hoặc thông tin nhạy cảm khác. Đồng thời, đánh giá việc truyền thông và đào tạo của tổ chức về GenAI, bao gồm: Đánh giá tần suất và tính toàn diện của truyền thông và đào tạo sử dụng GenAI; đánh giá mức độ hiển thị của các chính sách này đối với nhân viên và xem xét các số liệu (lượt truy cập vào các nội dung đào tạo, tỷ lệ hoàn thành đào tạo) để đánh giá mức độ hiệu quả của việc đào tạo.

Kiểm toán nội bộ đóng vai trò quan trọng trong việc tư vấn cho các nhóm làm việc về GenAI và nêu bật các rủi ro, tác động của chúng đối với chiến lược phát triển của tổ chức; đánh giá việc ra quyết định chính sách GenAI của tổ chức; đánh giá các kế hoạch ban hành, cập nhật chính sách, quy tắc sử dụng và phát triển AI. Bên cạnh đó, kiểm toán nội bộ phải đánh giá các quy trình để phê duyệt việc sử dụng AI và GenAI, bao gồm: Đánh giá các quy trình và hệ thống để phê duyệt các trường hợp sử dụng GenAI trong tổ chức; vai trò và trách nhiệm đằng sau việc phê duyệt các quyết định và thay đổi chính sách; xem xét mức độ tuân thủ các quy trình phê duyệt khi sử dụng AI.

Việc sử dụng và phát triển AI đã dấy lên nhiều lo ngại về sự thay đổi nhân lực, văn hóa công sở, trả lương cho nhân viên và những tác động của AI trong dài hạn. Mặc dù các tổ chức đều lạc quan về tiềm năng của AI trong việc thúc đẩy tiết kiệm chi phí và tăng năng suất, nhưng các nhà lãnh đạo cũng lo ngại về nhân lực. Do đó, kiểm toán viên nội bộ cần cung cấp thông tin chi tiết và tư vấn cho các nhà lãnh đạo về phương pháp tiếp cận mới giúp thu hẹp khoảng cách về nhân lực trong khi vẫn tiết kiệm chi phí và tận dụng tối đa ưu thế của AI./.